Différence entre la classification et la régression

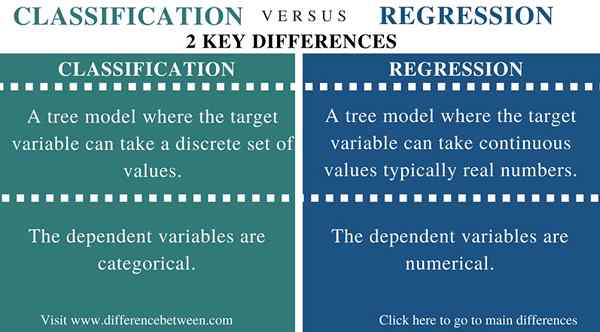

Le différence clé entre la classification et l'arbre de régression est que En classification, les variables dépendantes sont catégoriques et non ordonnées tandis que dans la régression, les variables dépendantes sont des valeurs entières continues ou ordonnées.

La classification et la régression sont des techniques d'apprentissage pour créer des modèles de prédiction à partir de données recueillies. Les deux techniques sont présentées graphiquement comme des arbres de classification et de régression, ou plutôt des organigrammes avec des divisions de données après chaque étape, ou plutôt, «branche» dans l'arbre. Ce processus est appelé partitionnement récursif. Des champs tels que l'exploitation minière utilisent ces techniques d'apprentissage de classification et de régression. Cet article se concentre sur l'arbre de classification et l'arbre de régression.

CONTENU

1. Aperçu et différence clé

2. Qu'est-ce que la classification

3. Qu'est-ce que la régression

4. Comparaison côte à côte - Classification vs régression sous forme tabulaire

5. Résumé

Qu'est-ce que la classification?

La classification est une technique utilisée pour arriver à un schéma qui montre l'organisation des données à commencer par une variable précurseur. Les variables dépendantes sont ce qui classe les données.

Figure 01: Exploration de données

L'arbre de classification commence par la variable indépendante, qui se ramifie en deux groupes tels que déterminés par les variables dépendantes existantes. Il est censé élucider les réponses sous la forme de catégorisation provoquée par les variables dépendantes.

Qu'est-ce que la régression

La régression est une méthode de prédiction basée sur une valeur de sortie numérique supposée ou connue. Cette valeur de sortie est le résultat d'une série de partitions récursives, chaque étape ayant une valeur numérique et un autre groupe de variables dépendantes qui se ramifient vers une autre paire comme celle-ci.

L'arbre de régression commence par une ou plusieurs variables précurseurs et se termine avec une variable de sortie finale. Les variables dépendantes sont soit des variables numériques continues ou discrètes.

Quelle est la différence entre la classification et la régression?

Classification vs régression | |

| Un modèle d'arbre où la variable cible peut prendre un ensemble de valeurs discrètes. | Un modèle d'arbre où la variable cible peut prendre des valeurs continues généralement des nombres réels. |

| Variable dépendante | |

| Pour l'arbre de classification, les variables dépendantes sont catégoriques. | Pour l'arbre de régression, les variables dépendantes sont numériques. |

| Valeurs | |

| A une quantité définie de valeurs non ordonnées. | A soit des valeurs discrètes mais ordonnées, soit des valeurs indiscrets. |

| But de construction | |

| Le but de la construction de l'arbre de régression est d'adapter un système de régression à chaque branche déterminante d'une manière que la valeur de sortie attendue apparaît. | Un arbre de classification se ramifie comme déterminé par une variable dépendante dérivée du nœud précédent. |

Résumé - Classification vs régression

Les arbres de régression et de classification sont des techniques utiles pour tracer le processus qui pointe vers un résultat étudié, que ce soit en classification ou une seule valeur numérique. La différence entre l'arbre de classification et l'arbre de régression est leur variable dépendante. Les arbres de classification ont des variables dépendantes qui sont catégoriques et non ordonnées. Les arbres de régression ont des variables dépendantes qui sont des valeurs continues ou des valeurs entières ordonnées.

Référence:

1.«Apprentissage des arbres de décision." Wikipédia, Fondation Wikimedia, 13 mai 2018. Disponible ici

Image gracieuseté:

1.«Data Mining» par Arbeck - Propre travaux, (CC par 3.0) via Commons Wikimedia